Inovação e regulamentação de mãos dadas para proteger o futuro da Inteligência Artificial

O mês de agosto marca o início de uma importante era na União Europeia com a entrada em vigor do Regulamento da Inteligência Artificial.

A Inteligência Artificial (IA) é hoje inquestionavelmente reconhecida numa ampla diversidade de tecnologias em rápida evolução e capazes de, não raras vezes, contribuir significativamente em termos económicos, ambientais e sociais, de forma ampla e agnóstica para as mais variadas indústrias e setores.

De todo o modo, é fácil compreender que, dependendo da sua utilização e evolução tecnológica, a aplicação da IA pode gerar riscos e prejudicar interesses – públicos ou privados – e direitos fundamentais que devem ser devidamente salvaguardados.

É neste contexto que acaba de ser publicado o Regulamento IA, o primeiro marco normativo que pretende regular o uso e aplicação de IA na UE. Na raiz deste novo regime jurídico está um objetivo de harmonização de procedimentos capazes de promover uma abordagem à IA centrada no ser humano e, em particular, capaz de assegurar a vanguarda mundial no desenvolvimento de um sistema de IA de forma segura, ética e de confiança, mediante a definição de regras de colocação no mercado, colocação em serviço e de utilização de sistemas de IA.

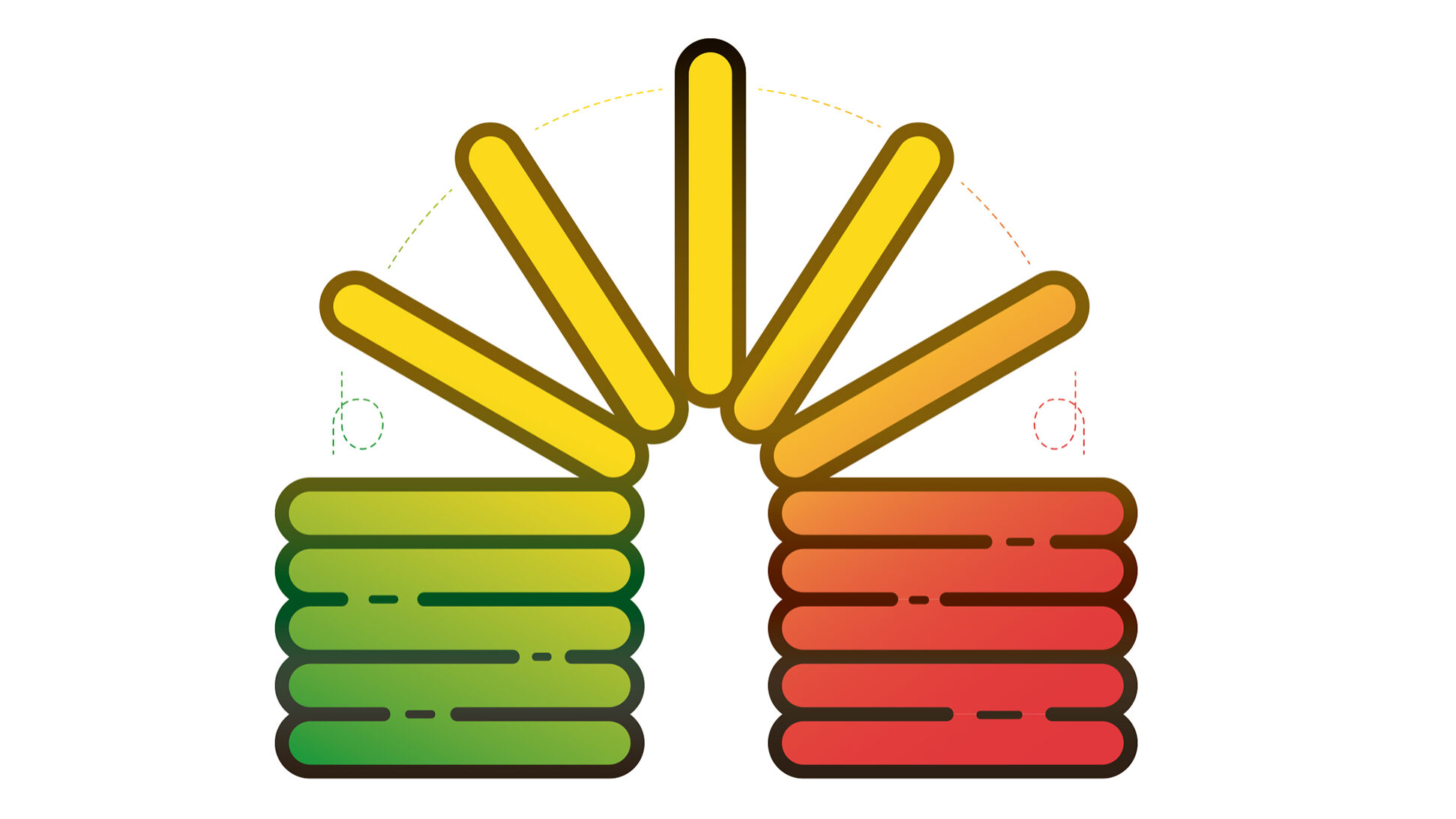

Para cumprir tal desiderato, o normativo define quatro níveis de risco para as aplicações de IA:

- Mínimo: Aqui recai a maioria dos sistemas de IA, não enfrentando obrigações face ao seu risco mínimo para com os direitos e a segurança dos cidadãos. Tal não obsta a que as empresas possam adotar, voluntariamente, códigos de conduta suplementares.

- Limitado: Estes sistemas estarão sujeitos a obrigações de transparência mais ligeiras, como por exemplo, a divulgação clara que os utilizadores estão a interagir com IA (e.g., chatbots) permitindo aos utilizadores tomar decisões informadas quanto à sua utilização.

- Elevado: Estes sistemas incluem, por exemplo, ferramentas de avaliação de risco e fixação de preço em seguros de saúde ou vida ou até de concessão de crédito, o que sublinha a importância da robustez, cibersegurança, exatidão e ausência de viés na utilização de IA. Este risco deverá ser mitigado através, por exemplo, da utilização de dados de alta qualidade e a garantia de supervisão humana.

- Inaceitável: Os sistemas de IA que representem uma clara ameaça aos direitos fundamentais dos cidadãos serão proibidos (e.g., sistemas ou aplicações que manipulem o comportamento humano para contornar a livre vontade dos utilizadores, ou sistemas de avaliação social que categorizem as pessoas com base, por exemplo, no seu comportamento ou características pessoais).

Este regulamento estabelece, ainda, regras específicas para modelos de IA de uso geral, que são partes integrantes de diversas aplicações de IA. Os modelos que executam uma ampla variedade de tarefas, deverão também cumprir requisitos de transparência em todas as etapas do processo, assegurando uma gestão adequada dos riscos das tecnologias inerentes.

As empresas que não cumpram o estipulado neste normativo estarão sujeitas a danos – materiais e imateriais – potencialmente expressivos (incluindo coimas no limite até 7% do volume de negócios anual se as violações forem graves).

Mas, como é natural, este regulamento respeitará a liberdade da ciência e apoiará a inovação, não prejudicando atividades de investigação e desenvolvimento (I&D): (i) exclui, por isso, do seu âmbito sistemas e modelos de IA especificamente desenvolvidos e colocados em serviço exclusivamente para fins de I&D científicos; (ii) assegura que não afeta atividades científicas de I&D em matéria de sistemas ou modelos de IA antes de colocação no mercado ou em serviço.

Assim, a inovação acelerada destes sistemas requer uma supervisão regulamentar e a criação de um espaço seguro e controlado para a experimentação, garantindo-se que as atividades de inovação são desenvolvidas de forma responsável. Sob a responsabilidade das autoridades de cada Estado-membro (EM) estará, então, a criação de, pelo menos, um ambiente de testagem da regulamentação da IA que assegure essa supervisão regulamentar de forma rigorosa, prévia à colocação desses sistemas no mercado ou em serviço.

É, por isso, que todos os programas e projetos de financiamento da UE executados pela Comissão Europeia (CE) e pelos EM, a nível nacional ou europeu, deverão contribuir para a prossecução dos objetivos deste regulamento. Tal já acontece, por exemplo, com o Horizonte Europa, onde é requerida uma fundamentação sobre a robustez técnica e social dos sistemas de IA a utilizar e/ou desenvolver, fundamentando-se, em paralelo, que tais sistemas de IA serão devidamente capacitados em termos de cibersegurança e serão capazes de fornecer uma explicação adequada dos seus processos de tomada de decisão se, por exemplo, tiverem um impacto significativo na vida das pessoas.

Em termos de horizonte de aplicação jurídica, os EM terão até agosto de 2025 para designar as autoridades competentes que supervisionarão a sua aplicação, tendo a maioria das demais regras do regulamento de ser aplicáveis apenas a partir de agosto de 2026. Procurando colmatar este período de transição, a CE lançou um Pacto para a IA, que visa estimular os criadores de tecnologias IA a adotarem voluntariamente as principais obrigações do regulamento antes dos prazos legais.

Resulta, assim, cristalino como este regulamento é uma mensagem direta da CE à proteção dos direitos fundamentais dos seus cidadãos; promovendo, concomitantemente, um ambiente mais propício à inovação, fornecendo às empresas um guia sobre como desenvolver e implementar sistemas de IA de forma ética e responsável.

Nota: Os pontos de vista e opiniões aqui expressos são os meus e não representam nem refletem necessariamente os pontos de vista e opiniões da KPMG em Portugal.

Assine o ECO Premium

No momento em que a informação é mais importante do que nunca, apoie o jornalismo independente e rigoroso.

De que forma? Assine o ECO Premium e tenha acesso a notícias exclusivas, à opinião que conta, às reportagens e especiais que mostram o outro lado da história.

Esta assinatura é uma forma de apoiar o ECO e os seus jornalistas. A nossa contrapartida é o jornalismo independente, rigoroso e credível.

Comentários ({{ total }})

Inovação e regulamentação de mãos dadas para proteger o futuro da Inteligência Artificial

{{ noCommentsLabel }}